Глубокий фейк: манипуляции будущего

Представьте себе видео, на котором вы говорите. Это вы, ваш голос, ваши слова. Но это неправда, потому что вы прекрасно знаете: вы не говорили этого никогда. Вы никогда не говорили того, что видите и слышите. Это явление и называется “глубокий фейк”, или страшная эволюция фальшивых новостей.

И совсем не важно, что вы можете отправить это видео и разыграть когото. Проблема в том, что его могут увидеть другие и поверить, потому что в конце концов именно вы говорите, кто фигурирует на этом видео.

И вот вы недоумеваете: как возможна подобная ложь?

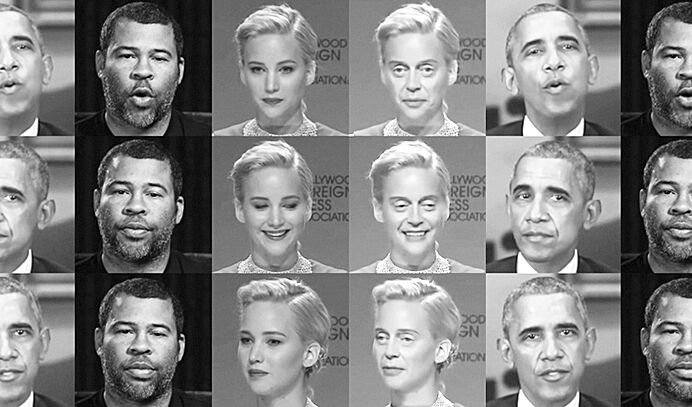

Такой алгоритм стал известен благодаря Вашингтонскому университету, который два года назад представил пилотный проект “Синтезирование Обамы”.

Бывший президент США Барак ОБАМА был своего рода подопытным кроликом. С одной стороны экрана он в своем кабинете и говорит одно, а с другой в другой одежде и в другом месте он говорит то же самое. Алгоритм позволяет манипулировать видео, синхронизируя звуки с движениями лица, особенно губ. И такие возможности опасны, если они используются для манипулирования информацией.

На первых порах технология была довольно грубой лишь приспосабливали движения рта к звукам, но ее улучшили с поразительным качеством.

Некоторые известные актрисы, в частности Скарлетт ЙОХАНССОН, уже стали жертвами этого алгоритма, но в другом варианте, где изображение заставили говорить то, чего не было. В этом случае лицо переносилось на порновидео, в котором играла совершенно другая актриса.

И это только начало. Учитывая возможность использования этого алгоритма в политических или криминальных целях, уже раздаются тревожные голоса, к примеру, в НАТО. Что произойдет, если в этом видео манипулируют политическим лидером, который говорит якобы о злодеяниях противников? Или если сфальсифицированный ролик демонстрирует, что какойто очень значимый человек совершает преступление? Однажды распространенную ложь невозможно остановить.

Эксперт Национального криптологического центра (CCN), входящего в Коалицию сетевой информации (CNI), сообщил, что фальшивки глубоких фейков развиваются очень быстро, мгновенно перескочив от манипуляций с порнографией в политическую сферу. Например, очень многие верят в подлинность фразы Обамы “Трамп идиот”, хотя тот никогда этого не говорил.

Тем не менее этот эксперт считает угрозу латентной: “В настоящее время фейки, как правило, представляют собой видео с небольшим движением, в которых только по морганию глаз можно определить подделку. Но годы идут, технологии совершенствуются, и вскоре будет очень трудно отличить ложь от истины. К тому времени, когда это произойдет, у YouTube, Facebook или WhatsApp должны быть механизмы, позволяющие контролировать и удалять фейки”.

Исследователь CCN объясняет: “Главная угроза не в создателях этих видео, а в распространителях. Кто стоит за этим? Кто может быть заинтересован в распространении? Идентификация фейков очень сложная, и в их распространении могут быть заинтересованы целые страны. Поэтому современные государства уже должны быть готовы к тому, что против них могут распространяться фальшивые новости. Но для их предотвращения должна быть выработана стратегия. Из CCN мы предлагаем декалог хороших практик для обнаружения манипулируемой информации”.

В этом отчете о дезинформации CCN говорится о доктрине ГЕРАСИМОВА, российского генерала, который утверждает, что после “арабской весны” наиболее практикуемые методы в конфликтах все больше связаны с использованием политической и экономической информации, которая дополняется военными средствами скрытого характера, основанными на информационных технологиях.

По данным того же документа, согласно различным исследованиям около 90 процентов населения Испании в возрасте от 16 до 65 лет могут стать жертвами дезинформационной атаки.

Хорошая новость заключается в том, что Испания является одной из стран, которая больше всего обеспокоена фейкньюс согласно совместному исследованию университета Наварры и Оксфордского университета. Это означает, что часть работы уже выполнена и население настороженно относится ко всему, что видит или читает.

Но отрицательный момент в том, что одним из главных последствий дезинформации является потеря доверия к государственным учреждениям и средствам массовой информации. И это недоверие уже наступило: опрос, проведенный в 2018 году барометром доверия Элдмана, гарантирует, что только 44 процента испанцев доверяют информации, которую они получают из СМИ.

Массмедиа, безусловно, являются четкой целью для создателей фейкньюс, поскольку они могут служить законным распространителем манипуляций. И в нашу эпоху, когда любая чепуха социальных сетей становится новостью, насколько влиятельными становятся фейкньюс?

При распространении фейкньюс обычно используют сеть собственных СМИ, оснащенную системами автоматизации, которые распространяют ложное сообщение по максимуму при очень низкой цене. Поэтому очень трудно определить происхождение дезинформации.

Вот почему CCN рекомендует читателю, помимо прочего, проверять источник, из которого поступает информация, не доверять скриншотам, полученным через сети, или сомневаться в аккаунтах предположительно реальных, которые на самом деле являются учетными записями. Кажется, что они настоящие, но на самом деле ложные.

До сих пор не хватает времени на совершенствование техники, которая отличала бы ложь от истины.

Дэвид САНЧО, эксперт компании Trend Micro по кибербезопасности, объясняет: “Для создания этих видеороликов в данный момент вам нужно иметь много материала о человеке, которым манипулируют. Вот почему Вашингтонский университет экспериментировал с Обамой. Был огромный архив его изображений, жестов и так далее, и это значительно облегчило задачу. Видео с изображениями известных актрис также подверглись манипулированию, потому что здесь тоже много доступного материала”.

Именно поэтому актер Стив БУШЕМИ, Джордж Буш и Владимир Путин служили “морскими свинками” для создания таких видеороликов.

По мнению Санчо, возможные угрозы фейкньюс многочисленны: “Помимо политических манипуляций это дает злоумышленнику много возможностей. Например, цены на акции могут быть изменены с помощью манипулируемого видео о мошенничестве, воровстве или вымогательстве в определенных компаниях. Конечно, в настоящее время для создания таких роликов необходимо большое количество реального материала, поскольку чем больше степень фальсификации, тем легче ее обнаружить. Но уже есть случаи, когда вы можете идентифицировать фальшивое видео только с помощью компьютерной криминалистической техники. Но если на видео манипулировать только звуком, возможности безграничны, потому что создавать ложные файлы намного проще”.

Брейс ИГЛЕСИАС, эксперт по кибербезопасности, объясняет: “Очень трудно отличить видео фейкньюс от реальной новости, потому что мы перегружены информацией. Во многих случаях нам удается быстро опровергнуть ее, но ущерб уже нанесен. И даже после опровержений остаются сомнения. Несмотря на текущее среднее качество фейка, правда заключается в том, что ему все еще часто верят”.

Вашингтонский университет объясняет на своем вебсайте с учетом опыта проекта “Синтезирование Обамы”, что качество алгоритма напрямую зависит от потраченного на него времени: через полчаса или час появляется относительно устойчивое видео, хотя со многими сбоями синхронизации между звуком и губами. Однако после ночи работы очень трудно отличить настоящее видео от манипулируемого.

Официальные источники из НАТО заверили: “Распространения фальшивой пропаганды очень беспокоит, и мы не должны недооценивать влияние, которое она оказывает на наше открытое общество. В долгосрочной перспективе это может подорвать доверие общественности к нашим демократиям и к нашей свободной прессе. Вот почему мы усиливаем сотрудничество с Европейским союзом и делимся анализом фейкньюс, проводимым нашими институтами”.

НАТО против дезинформации

Всемирный интерес к фейкньюс возник в 2016 году после президентских выборов в США. С тех пор существуют исследования, рабочие группы, конвенции и государственная политика против манипуляций.

Подписи к фото:

Алгоритм начал работать с изображений Обамы, и именно тогда зародилась пропаганда будущего: манипулируемые видео, которые попытаются изменить реальность, и даже больше.

Экспрезидент США Джордж БУШ, голосом и жестами которого манипулирует исследователь Юстус ТИЕС. И глава РФ Владимир ПУТИН после манипуляций Матиаса НИССМЕРА из лаборатории визуальных проектов Технического университета Мюнхена.